«No entremos desprevenidos», decía la carta, firmada por más de 1.000 líderes y expertos en el campo de la inteligencia artificial.

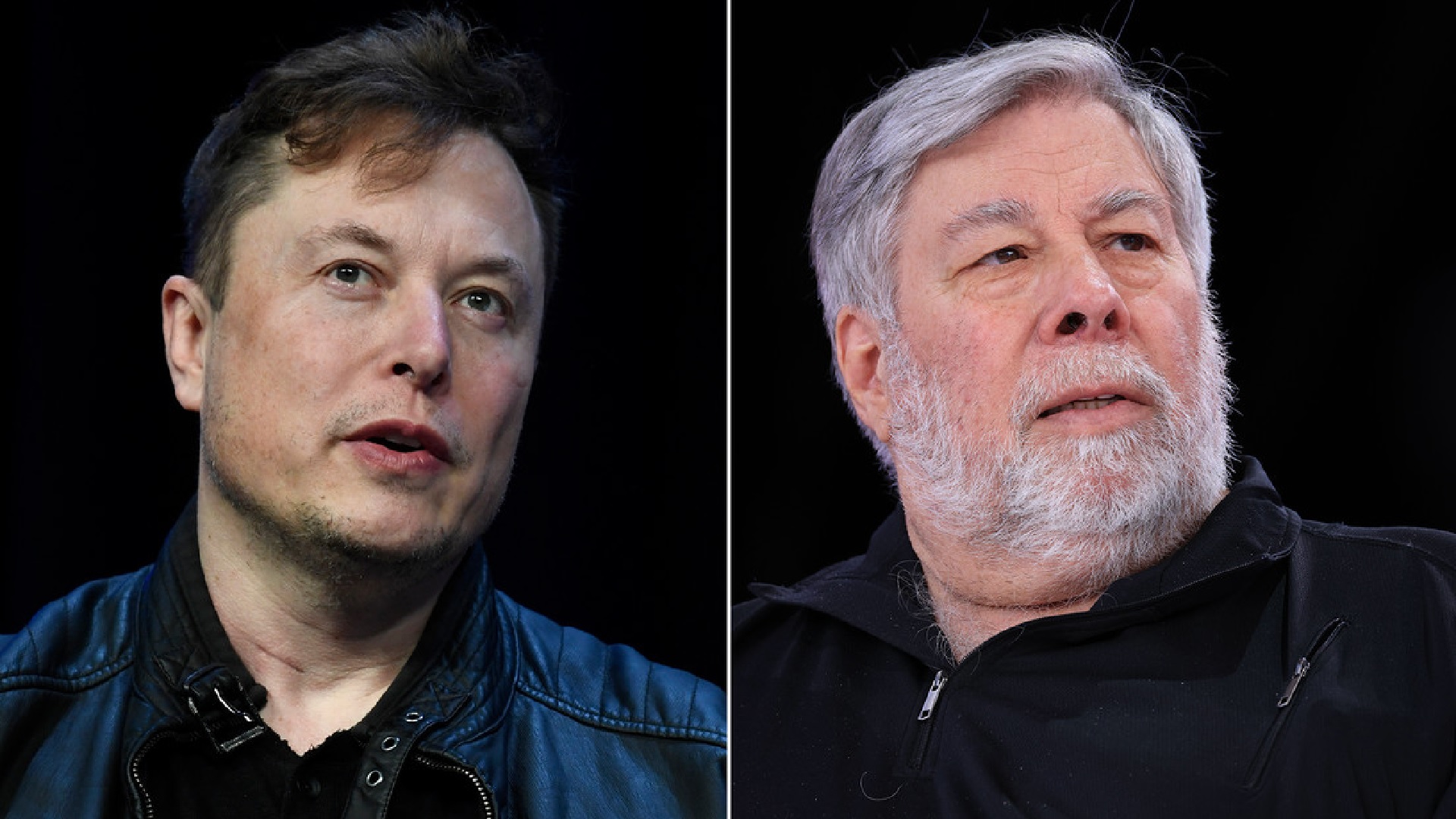

El CEO de SpaceX, Tesla y Twitter, Elon Musk, y el cofundador de Apple, Steve Wozniak, firmaron una carta en la que pedían el «cierre inmediato» de todos los laboratorios de inteligencia artificial (IA) que entrenan sistemas de inteligencia artificial más potentes que GPT-4 durante al menos 6 meses.

«Los sistemas de IA con inteligencia rival humana pueden plantear serios riesgos para la sociedad y la humanidad, como lo demuestra una extensa investigación y lo confirman los principales laboratorios de IA», dice la carta, firmada por expertos de más de 1.000 líderes de IA.

Un artículo publicado el miércoles pasado por la organización sin fines de lucro Future of Life Institute denuncia una inteligencia artificial avanzada que potencialmente representa un cambio profundo en la historia de la vida en la Tierra. En tales casos, se recomienda la «planificación y gestión con el cuidado y los recursos adecuados», ya que garantizan que no se produzca este nivel de gestión.

Aunque los laboratorios de IA han estado en una «carrera» en los últimos meses para diseñar e implementar cerebros digitales cada vez más potentes, nadie, ni siquiera sus creadores, puede entenderlos, predecirlos o controlarlos con certeza.

El 16 de marzo, el director ejecutivo de OpenAI, Sam Altman, admitió que estaba «un poco asustado» por la creación de ChatGPT y agregó que estaba «particularmente preocupado de que estos modelos pudieran usarse para la desinformación a gran escala». En cuanto a GPT-4, la nueva versión de ChatGPT «demuestra un rendimiento a nivel humano en una variedad de puntos de referencia académicos y profesionales».

El mismo día, el motor de búsqueda chino Baidu presentó su alternativa en chino a ChatGPT, un chatbot de IA llamado «Ernie bot», cuyas tareas incluyen la comprensión y generación de idiomas, la conversión de texto a imagen, la composición de poesía y la generación de texto. en dialecto chino. También puede crear planes de viaje y transmisiones en vivo para lanzamientos de productos.

«Para evitar ser atrapado por accidente»

«¿No debería permitirse que las máquinas inunden nuestros canales de información con propaganda y mentiras?» instaron en su carta. ? ¿Deberíamos arriesgarnos a perder el control de nuestra civilización? ‘ continuaron. En este sentido, contribuyen al desarrollo de sistemas de inteligencia artificial si se tiene confianza en que su impacto será positivo y los riesgos manejables.

A continuación, explique que la sociedad anteriormente se ha quedado corta ante otras tecnologías que podrían tener efectos catastróficos en los humanos, como la clonación humana y otras áreas de la genética. «Podemos hacerlo», exigieron. “No nos apresuremos a caer desprevenidos”, concluyeron. tomarnos desprevenidos»

Fuente: Musk y Wozniak, entre los 1.000 expertos que piden que se frene el entrenamiento de la IA – RT